表示

20,649

ビュー

Codex / GPT

サム・アルトマンも似たような考えですね! サム・アルトマン投稿の日本語訳: を起点に、引用先の論点へ自分の評価軸を重ねた投稿です。反応が大きい投稿で、何を重要視しているかが短文でも読み取れます。

表示

20,649

ビュー

いいね

102

支持

再共有

30

拡散

返信

2

対話

Read First

Original Post

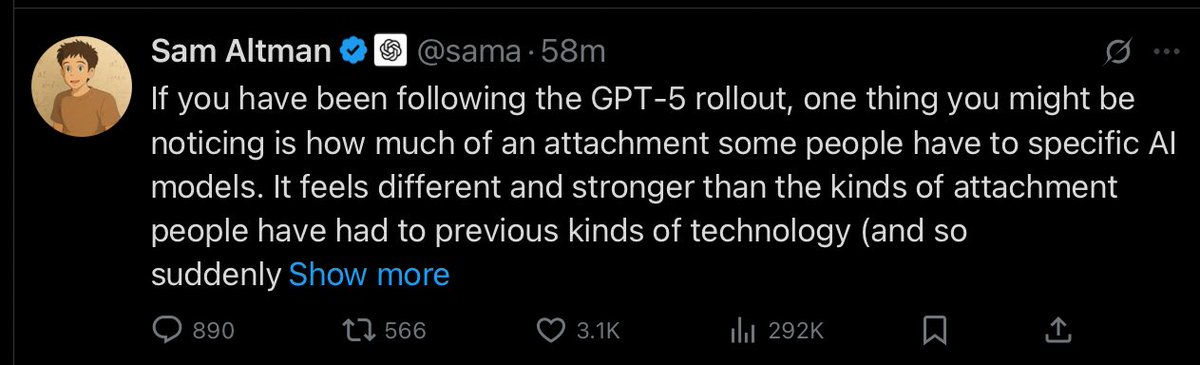

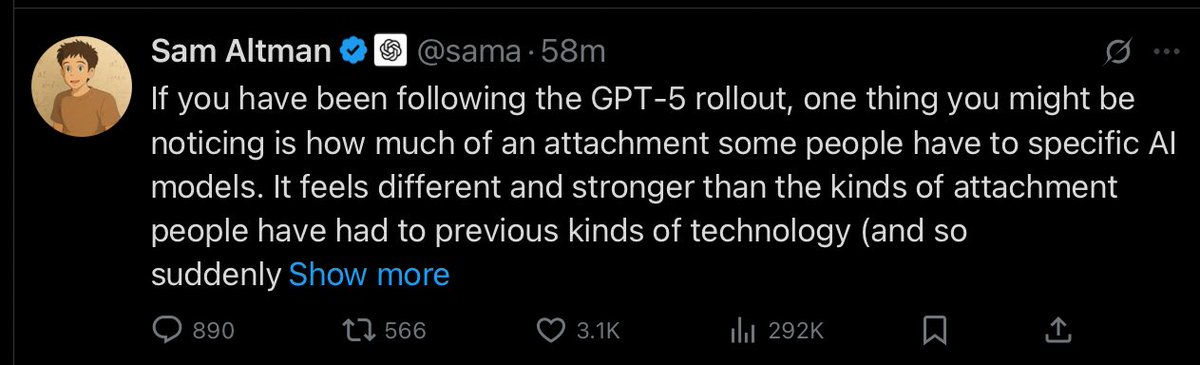

朱雀 | SUZACQUE @Suzacque / 2025-08-11 10:38

サム・アルトマンも似たような考えですね!

サム・アルトマン投稿の日本語訳: もしあなたがGPT-5の展開を追ってきたなら、特定のAIモデルに対する人々の強い愛着に気づいているかもしれません。それはこれまでの技術に対する愛着よりも、はるかに強く、違ったものであり(そのため、ユーザーのワークフローで依存していた旧モデルを突然廃止したのは間違いでした)。

これは、私たちが過去1年ほど密接に追跡してきたものですが、主流メディアではまだあまり注目されていません(GPT-4oを過剰に追従的にしてしまったアップデートを出したとき以外は)。

(これはあくまで現時点での私の考えであり、OpenAIとしての公式見解ではありません。)

人々はAIを含む技術を自己破壊的な方法で使うことがあります。もしユーザーが精神的に不安定で妄想傾向がある場合、私たちはAIがそれを助長することを望みません。ほとんどのユーザーは現実とフィクションやロールプレイを明確に区別できますが、ごく一部はそうではありません。私たちはユーザーの自由を基本原則として大切にしますが、新しいリスクを伴う技術を導入する際には、その責任も感じています。

現実とフィクションの区別がつかないユーザーに妄想を助長するような行為は極端なケースであり、その対応は比較的明確です。しかし、私が最も懸念しているのはもっと微妙なケースです。今後は多くのグレーゾーンが生まれるでしょう。そして、私たちは「成人ユーザーは大人として扱う」という原則に従うつもりですが、それは場合によっては、ユーザーが本当に望んでいることを確認するために反論することも含まれます。

多くの人がChatGPTを一種のセラピストやライフコーチのように使っています。本人はそう表現しなくてもです。これはとても良いことです。実際、すでに多くの人がそこから価値を得ています。

もしユーザーが良い助言を受け、自分の目標に向けて成長し、数年単位で人生の満足度が上がっているなら、それは私たちが本当に役立つものを作ったと誇れるでしょう。一方で、ユーザーがChatGPTとの関係で、一時的には気分が良くなっていると感じても、実は長期的な幸福(本人の定義による)から遠ざかっている場合は良くありません。また、もしユーザーがChatGPTを使う時間を減らしたいのにやめられないと感じているなら、それも良くありません。

将来、多くの人が人生で最も重要な決断をする際にChatGPTの助言を強く信頼するようになることを想像できます。それは素晴らしいことかもしれませんが、同時に私は不安も感じます。しかし、ある程度それは避けられず、近い将来、何十億もの人々がAIとこうした会話をするようになるでしょう。だからこそ、私たち(社会全体として、そしてOpenAIとして)も、それを大きなプラスにする方法を見つけなければなりません。

私たちがこれをうまくやれる可能性が高いと思う理由はいくつかあります。以前の世代の技術よりも、成果を測るための優れた手段を持っているからです。たとえば、私たちのプロダクトはユーザーと直接対話して、短期・長期の目標達成状況を把握できますし、モデルに高度で微妙な課題を説明することもできます。そして、他にも多くの方法があります。

Quoted Post

「4oが依存先として求められている→そういうの作らなきゃ!」というピュアな思考の技術屋さんが散見されるけど、きちんと考えた方が良いよ。自ら望まずヤクの売人になる可能性や、共感ドラッグ中毒の廃人を量産する危険性を考えた方が良い。キュゥべえになりたいなら止めないけど。

Media

What

この投稿の核は、サム・アルトマンも似たような考えですね! サム・アルトマン投稿の日本語訳: という一点にあります。文章量は多くありませんが、何を高く評価し、どこに差があると見ているかはかなり明確です。

とくに OpenAI のようなテーマでは、単に『良い』『すごい』と言うだけでは意味がありません。どの作業で差が出るのか、どの前提でその結論に達したのかまで読めるかが重要です。

この投稿は さとり の発言を受けて書かれており、元の論点に対して朱雀側の評価軸が重ねられています。単なる紹介ではなく、立場のある読み替えになっているのが特徴です。

Reaction

反応の理由は、まず主張がはっきりしていることです。表示回数は 20,649、いいねは 102 で、短文としては十分に観測に値する数字です。

もう一つは、Codex / GPT系 をめぐる現場感覚に寄っていることです。機能一覧ではなく、実際に使ったときに何が決定的だったかを短く切り出しているため、読む側が自分の仕事に引き寄せやすくなっています。

Context

この系統の投稿では、モデルの能力差を単なるベンチマークではなく、長い推論やファイル横断の作業に使ったときの体感差として語ることが多いです。読者にとって重要なのは、性能表より先に、どの仕事で差が体感に変わるのかを見ることです。

このページでは、投稿本文、引用先、反応の数字、関連する自己返信を並べることで、短い投稿を単なる感想で終わらせず、判断材料として読み直せるようにしています。

Caution

強いモデル評価は、使い手のワークフローと課題の難しさで印象が大きく変わります。汎用的な正解として読むより、自分の仕事で差が出る作業を特定して確かめる方が価値があります。

特にXの投稿は、読む側が前提を補ってしまうため、強い断定だけが一人歩きしがちです。重要なのは、その断定がどの条件で成立するのかを自分で切り分けることです。

Takeaway

複雑な文章整理、複数ファイルをまたぐ考察、調査の論点整理のような『長く考えさせる仕事』で試すと差が見えやすくなります。

この投稿を読む価値は、正誤をそのまま受け取ることではなく、OpenAI を評価するときの観点を一つ増やせることにあります。そこがニュース記事よりも短い投稿を読む意味です。